Академический Документы

Профессиональный Документы

Культура Документы

Apresent Redes Neurais

Загружено:

sanches.ferАвторское право

Доступные форматы

Поделиться этим документом

Поделиться или встроить документ

Этот документ был вам полезен?

Это неприемлемый материал?

Пожаловаться на этот документАвторское право:

Доступные форматы

Apresent Redes Neurais

Загружено:

sanches.ferАвторское право:

Доступные форматы

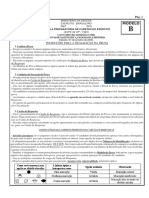

PSI-2222 Prof.

Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

PSI 2222 Inteligncia Computacional e Redes Neurais em Engenhria Eltrica

Prof. Emilio Del Moral Hernandez Escola Politcnica da Universidade de So Paulo Departamento de Eng. De Sistemas Eletrnicos

emilio_del_moral@ieee.org www.lsi.usp.br/~emilio

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Inteligncia Computacional e Neurocomputao

Neurocomputao Inteligncia Artificial Simblica Fuzzy Logic Algoritmos Genticos Classificao Estatstica Filtros Adaptativos Otimizao Identificao de modelos paramtricos Aprendizado de mquina Sistemas para o apoio deciso Processamento de informaes no estruturadas Processamento / reconhecimento / classificao de sinais e imagens Interfaces homem-mquina naturais Modelagem de sistemas no lineares multivariveis Bifurcao e dinmica catica no contexto de neurocomputao

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Redes Neurais Artificiais

So sistemas computacionais, de implementao em hardware ou software, que imitam as habilidades computacionais do sistema nervoso biolgico, usando um grande nmero de neurnios artificiais simples e interconectados entre si. Algumas aplicaes tpicas ...

Reconhecimento de caracteres Reconhecimento e Sntese de Voz Viso artificial Riscos de inadimplncia / deteo de padres de risco Previso de vendas / previso de sries temporais

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Dos Neurnios Biolgicos aos Artificiais

Neurnio Biolgico e Neurnio Artificial

Axnio Soma

Dendritos

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Redes Neurais Artificiais - Histrico

Dcada de 40: o neurnio McCullock and Pitts Dcada de 50:Em 1956 na 1a Conferncia Internacional de Inteligncia Artificial, foi apresentado um modelo de rede neural artificial pelo pesquisador Nathaniel Rochester, da IBM. Em 1959, foi demonstrada a rede Adaline Dcada 1960: a rede Perceptron de Rosenblat Em 1969, Marvin Minsky e Seymour Papert publicaram um livro chamado Perceptrons

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Redes Neurais Artificiais - Histrico

Em 1982, John Hopfield, apresentou um sistema neural artificial que permitia memorizarimagens nas interconexes entre os neurnios. Ainda em 1982 a primeira conferncia Estados Unidos - Japo sobre redes neurais realizou-se na cidade de Kioto. No Brasil, em 1994 ocorreu o primeiro congresso de Redes Neurais. Quadro atual ... SBRN / IJCNN / ICANN / ENNS / NNS etc ....

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

O Neurnio Biolgico

Dcadas de 50 e 60: neurnio biolgico passou a ser visto como um dispositivo computacional elementar do sistema nervoso, com muitas entradas e uma sada. Entrada - Conexes Sinpticas Informao - Impulsos Nervosos Impulso Nervoso: depolarizao da membrana celular

Potenciais de Ao

Tempo

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Adaline: Passos Iniciais ... um Modelo Linear

x1 x2 . . . xn

w1 w2 wn

Funo de Soma

soma de todas as soma = entradas * pesos n

Pesos (ajustveis)

soma= xi * wi i=1

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Adaline como Previsor Linear / Plasticidade sinptica

x1 x2 . . . xn Funo de Soma

w1 w2 wn

soma de todas as soma = entradas * pesos n

soma= xi * wi Pesos i=1 (ajustveis)

Filtros adaptativos / previsores lineares x(n+1) = a.x(n) + b.x(n-1) + c.x(n-2) + ... a, b, c ... Sao adaptados para otimizar a previsao Face a um conjunto de treinamento

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

... Vendo com mais detalhe ... a relao entre estmulo e atividade na sada no linear:

Potenciais de Ao

Tempo

Freq. De Pulsos (potenciais de ao) (Freq. Sat.)

Saturao

Estmulo Sublimiar

Depolarizao da Membrana

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Modelando Melhor a Relao Entrada / Sada

x0 Entradas x1

wj0 wj1 wj2

Funo de Soma

Sada i

x2

Pesos

Funo de Transferncia

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Resumo um n (neural) realiza a seguinte computao analgica

x0

ENTRADA

y

1

y = fT ( wi xi - )

xN -1

wN -

SADA

Saturao

(Freq. Sat.)

Estmulo Sublimiar

Depolarizao da Membrana

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Funo de transferncia no linear do tipo sigmide ou tangente hiperblica

Preserva - se o fenmeno da saturao Preserva - se a monotonicidade na faixa dinmica Temos funes matematicamente amigveis

SIGMIDE

1,2 1 0,8 0,6 0,4 0,2 0 -6 -4 -2 0 2 4 6

TANGENTE HIPERBLICA

1,5 1 0,5 0 -6 -4 -2 -0,5 0 -1 -1,5 2 4 6

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Outras funes de transferncia no linear

H a r d L im it e r ( lim it e r p id o ) x 1

-1

R a m p in g F u n c t io n ( fu n o d e r a m p a )

x 1 y

1

s < 0 , y = -1 s > 0, y = 1

s < 0, y = 0 0 <= s <= 1, y = s s 1, y = 1

S ig m o id e F u n c t io n ( f u n o s ig m id e ) x

1

S ig m o id e F u n c t io n ( f u n o s ig m id e ) x 1

-1

y

y = 1 /(1 + e -s)

x > = 0 , y = 1 -1 /(1 + s) x < 0 , y = -1 + 1 /(1 -s)

Com escalamento do argumento, pode-se abarcar os universos digital e analgico / linear e no linear simultaneamente

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

O Perceptron: y=signal( wi xi - ) (funo de transferncia tipo degrau)

Viabiliza a classificao de padres com separabilidade linear O algoritmo de aprendizado adapta os Ws de forma a encontrar o hiperplano de separao adequado Aprendizado por conjunto de treinamento

xi

A AA A A A A A A A B

Exemplos - de Pares (x0;x1) da classe A

B

Hiperplano Separador

B B B B B B B

Exemplos - de Pares (x0;x1) da classe B

xo

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Cmputos mais complexos so realizados pelo encadeamento de vrios ns

Axnio

Sinapse

Dendritos

A conexo entre um axnio de um neurnio e um dendrito de outro denominada Sinapse

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

O Multi Layer Perceptron (MLP)

Mltiplas entradas / Mltiplas sadas Ambas podem ser analgicas ou digitais No h mais a restrio de separabilidade linear

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Aproximao de funes com o MLP / superposio de sigmoides deslocadas

Ex: aplicao em metrologia e linearizao de sensores trabalho de mestrado de Itamar Magno Barbosa

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Outras aplicaes importantes do MLP

Alm de aproximao de funes genricas Fuso no linear de grandezas analgicas multidimensionais Previso de sries temporais no lineares Classificao de Padres multidimensionais sem separabilidade linear Note que o aprendizado por exemplos do MLP permite que ele realize as funes acima sem a necessidade de um modelo matemtico conhecido / confivel

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Fuso no linear de grandezas analgicas multidimensionais

y=F(x1,x2,x3,x4 .) F desconhecida Possibilidade: regressao linear / regressao no linear Problema: Com que forma funcional??? Chute 1: y = a.x1 +b.x2 +c.x3 +d.x4 + etc Chute 2: y = a.x1.x1 +bx1.x2 +c.x2.x2 +d.x1.x3 + Chute 3: y = [a.x1.x2 +c.log(x3)]*d.x4 + etc Chute 4: y =

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Fuso No Linear Aproximaao Universal de Funoes Quaisquer Multivariadas

y=F(x1,x2,x3,x4 .) F desconhecida Teorema de Kolmogorov / Cybenko: F(x1,x2,x3,x4 .) ~ a.f1(x1) +b.f2(x2) +f3(x3) sendo a aproximaao arbitrariamente proxima Cybenko >> adaptou Kolmogorov para f1, f2 sintetizadas por soma ponderada de sigmoidais (ou seja, F arbitraria e implementavel em RNA !!)

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Aproximao Universal / Outras Implicaoes

Classificaao de Padroes: Pertinencia a Classe A = FA(x1,x2,x3,x4 .) FA, funao digital desconhecida Pertinencia a Classe B = FB(x1,x2,x3,x4 .) idem para classe C, D, etc Previsao de Series Temporais nao lineares: x(n+1) = F(x(n),x(n-1),x(n-2), ) F, funao generica desconhecida

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Aprendizagem das Redes Neurais

O aprendizado por exemplos do MLP permite que ele realize diversas funes sem a necessidade de um modelo matemtico conhecido / confivel Redes Neurais possuem capacidade de aprender por exemplos As informaes so apresentadas a rede que extrai informaes a partir dos padres apresentados

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Aprendizado Supervisionado

As informaes so apresentadas rede sob forma de padres de entrada e os resultados desejados so conhecidos previamente. O supervisor verifica a sada da rede e a compara com a sada esperada Minimizao da diferena Os algoritmos mais conhecidos so : Regra Delta Backpropagation

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

O Ajuste sinptico durante o aprendizado

Quando ocorre erro no reconhecimento / tratamento de uma entrada, um ajuste sinptico necessrio. O ajuste sinptico representa o aprendizado em cada neurnio do fato apresentado O ajuste sinptico procura corrigir os pesos de modo que se produza a sada desejada diante da respectiva entrada. Esse clculo visa somar ao peso atual, um valor que corresponda a quantidade de erro gerada pela rede, e desta forma corrigir o valor do peso. O conhecimento dos neurnios reside nos pesos sinpticos.

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Exemplo de ajuste sinptico Entrada X Sada Y

resultado esperado

Algoritmo: .Aplicar entrada X .Comparar sada Y com a sada desejada .Se sada estiver errada ento .Calcular ajuste em pesos .Aplicar nova entrada

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Exemplo de ajuste sinptico

A etapa calcular erro obtida atravs da Regra Delta: wi (n + 1) = wi(n) + Regra Delta traduzida... Erro = sada esperada - sada obtida Peso novo = Peso antigo + (Erro * Entrada * Constante)

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Outras aplicaes importantes do MLP

Alm de aproximao de funes genricas Fuso no linear de grandezas analgicas multidimensionais Previso de sries temporais no lineares Classificao de Padres multidimensionais sem separabilidade linear Note que o aprendizado por exemplos do MLP permite que ele realize as funes acima sem a necessidade de um modelo matemtico conhecido / confivel

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Redes neurais com realimentao

Conceito: o estado presente de cada n afeta os estados futuros O sistema dinmico Uma arquitetura realimentada particular: a rede de Hopfield Pesos simtricos / ns digitais

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Aplicao de redes neurais de Hopfield

Armazenamento de padres (imagens) de interesse e recuperao dos mesmos a partir de verses distorcidas ou parciais Memrias Autoassociativas / Endereadas por Contedo

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Memrias associativas de Hopfield

M T W = MID =1

wij nodes

12% noise Aplicaes prototpicas de redes associativas operando em strings binrios: recuperao de padres a partir de verses distorcidas ou parciais dos mesmos

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Deteo de novidade e aprendizado incremental em redes de Hopfield

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Recuperao de bits tpica em memrias autoassociativas de Hopfield

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Redes Neurais Hbridas MLP+H

Trabalho com Clayton Silva Oliveira

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Arquiteturas de Kohonen (SOM) para clustering

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Dados so agrupados em torno de prottipos organizados em espao bidimensional

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Redes SOM de Kohonen e o Aprendizado No-Supervisionado

O aprendizado auto-supervisionado no requer sadas desejadas e por isso conhecido pelo fato de no precisar de professores para o seu treinamento. Para o treinamento da rede, so usados apenas os valores de entrada. A rede trabalha essas entradas e se organiza de modo que acabe classificando-as, usando para isso, os seus prprios critrios.

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Algumas aplicaes de mapas auto organizveis de Kohonen (SOM)

Diviso de universos de dados multidimensionais em sub-grupos de elementos similares (Congresso ABAR 2003 segmentao de empresas do setor eltrico trabalho de Virginia Parente et al.) Data mining Pr processamento de dados multidimensionais para posterior classificao, de padres dentro de sub universos mais especficos

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Projeto SIIAM CNPq (Anlise Multissensorial)

Demonstradores de Sistemas Aplicveis nas reas ambiental e biomdica / anlise multissensorial:

1.Microssistemas e sensores com algum processamento local de dados + 2.Rede de transmisso de dados + 3.Central de processamento e armazenamento de informao

Pesquisadores de trs diferentes reas do IPT e EPUSP Processamento de sinais / Reconhecimento de padres / Inteligncia computacional so particularmente importantes na implementao das componentes 1 e 3 acima

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Qualidade de guas / anlise multissensores

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP Aplicao das RNAs na Confiabilidade Metrolgica

MsC. Itamar Magno Barbosa

Doutorando Redes Neurais & Metrologia itamar@lsi.usp.br

Aplicao das MLPs nas curvas de calibrao da Balana Externa do tnel de vento TA-2. Balana Externa => Instrumento de medio de foras e momentos aerodinmicos.

Sendo os smbolos: w = vetor pesos sinpticos J = matriz Jacobiana = taxa de aprendizado e = vetor erros na sada uj2 = matriz de covarincias I = matriz identidade

Ajuste clssico dos pesos sinpticos em MLPs: w (n+1) = w(n) (JT(n) J(n)+I)-1 JT(n) e(n) Proposta na dissertao de mestrado => Algoritmo de aprendizado para MLPs, levando em considerao as incertezas associadas s medies : w (n+1) = w(n) (JT(n) (uj2)-1 J(n)+I)-1 JT(n) (uj2)-1 e(n)

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Tcnicas de Processamento de Imagens para extrao de atributos de exames mamogrficos

ndulo benigno com contorno circunscrito

ndulo benigno com contorno espiculado.

a)

c)

ndulo maligno com contorno espiculado.

ndulo maligno com contorno circunscrito.

b)

d)

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Comit de Redes Neurais p/ classificao de detalhes do mamograma (ROI)

Trabalho com Leandro Augusto da Silva (Mestre em E.E., e Doutorando em E.E.)

-1 1 benigno maligno

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Destacando Trabalhos em Neurocomputao

Estudo de novos modelos de computao neural envolvendo fenmenos de bifurcao e dinmica catica Desenvolvimento de novas arquiteturas neurais a partir da fuso de mais de uma arquitetura clssica Clustering de dados multidimensionais Emprego de redes neurais em reconhecimento e classificao de padres Fuso de informaes em sistemas multissensores Data mining em bases de dados e na WWW Aproximao de funes e modelagem de histerese

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Alguma Bibliografia Bsica + Links

Kovcs, Zsolt L. - Redes Neurais Artificiais - Fundamentos e Aplicaes, Collegium Cognito, 1996 Lippmann, Richard P. - An Introduction to Computing with Neural Nets, IEEE-Magazine April, 1987 Referncias de diversos nveis de profundidade atravs

do site ww.lsi.usp.br/~emilio Simon Haykin Neural Networks: A Comprehensive Foundation, 1999 tambm traduzido

PSI-2222 Prof. Emilio Del Moral Inteligncia Computacional e Redes Neurais 2005 EPUSP

Minhas coordenadas .

Prof. Emilio Del Moral Hernandez Escola Politcnica da Universidade de So Paulo Departamento de Eng. De Sistemas Eletrnicos

emilio_del_moral@ieee.org www.lsi.usp.br/~emilio

Вам также может понравиться

- Prova 5º Ano Ciencias 4 BimestreДокумент3 страницыProva 5º Ano Ciencias 4 BimestreEmerson Plouvier Rosa75% (4)

- Composição Visual PDFДокумент225 страницComposição Visual PDFghutenthag100% (2)

- Dossie15 Tambor PDFДокумент104 страницыDossie15 Tambor PDFFrazão AndréaОценок пока нет

- OS MESTRES ROM (Abduções As em World - Wesley HДокумент9 страницOS MESTRES ROM (Abduções As em World - Wesley Hapi-3825181100% (1)

- Atas Dharana UmДокумент15 страницAtas Dharana UmJoao MarcosОценок пока нет

- Ensaio - Design e Democracia Gui BonsiepeДокумент8 страницEnsaio - Design e Democracia Gui BonsiepeJulia Marchesini100% (1)

- Modulo 1 TCATДокумент15 страницModulo 1 TCATAndre FreitasОценок пока нет

- Atividade Sociologia Dilema Das RedesДокумент4 страницыAtividade Sociologia Dilema Das RedesJose AmorimОценок пока нет

- IntegreseДокумент16 страницIntegreserobcavОценок пока нет

- Tabela de Tamanhos Mínimos de Captura 10-11-17Документ2 страницыTabela de Tamanhos Mínimos de Captura 10-11-17Tiago CandeiasОценок пока нет

- Ditados Populares - S.NДокумент33 страницыDitados Populares - S.NRogérioCamargoОценок пока нет

- Historia Acp BrasilДокумент10 страницHistoria Acp BrasilSilvia Raquel Santos De MoraisОценок пока нет

- Ebook Dentalclean Tudo Sobre Os Dentes Da CriancaДокумент19 страницEbook Dentalclean Tudo Sobre Os Dentes Da CriancaJonas SantosОценок пока нет

- Iraja Menezes LIRIQUESДокумент87 страницIraja Menezes LIRIQUESIrajáMenezesОценок пока нет

- Firo e Practice (Salvo Automaticamente)Документ15 страницFiro e Practice (Salvo Automaticamente)Estudos EnemОценок пока нет

- Quero Te AmarДокумент2 страницыQuero Te AmarHenriqueОценок пока нет

- Analogia de Mohr e Eq 3 Momentos PDFДокумент11 страницAnalogia de Mohr e Eq 3 Momentos PDFfernandoteixeiracefetОценок пока нет

- 2.1 - Fichamento Texto - O Mundo de Ulisses - M. I. FinlayДокумент3 страницы2.1 - Fichamento Texto - O Mundo de Ulisses - M. I. FinlayJoão Victor ÁvilaОценок пока нет

- VAPPДокумент9 страницVAPPGisselle MuraОценок пока нет

- Complexo Dentinopulpar - Mapa Mental - Amostra 4Документ1 страницаComplexo Dentinopulpar - Mapa Mental - Amostra 4Wanessa FornerОценок пока нет

- Slides Sobre Sociologia Dos Tribunais PDFДокумент53 страницыSlides Sobre Sociologia Dos Tribunais PDFRaphael Silveiras100% (1)

- O Primado de Pedro - Resposta A Algumas Objeções ProtestantesДокумент3 страницыO Primado de Pedro - Resposta A Algumas Objeções ProtestantesGustavo RamosОценок пока нет

- FUNDAMENTOSДокумент240 страницFUNDAMENTOSigor iuriОценок пока нет

- Relógio de Sol, Peças Do TrabalhoДокумент18 страницRelógio de Sol, Peças Do TrabalhoEduardo PereiraОценок пока нет

- Modelo: Instruções para A Realização Da ProvaДокумент14 страницModelo: Instruções para A Realização Da ProvaDouglas SilvaОценок пока нет

- Simulado - Prova BrasilДокумент9 страницSimulado - Prova BrasilLucas de FreitasОценок пока нет

- Os Atributos Naturais de DeusДокумент7 страницOs Atributos Naturais de Deusangela cavalcanteОценок пока нет

- Desmilitarização Da Polícia MilitarДокумент2 страницыDesmilitarização Da Polícia MilitarArthur MagalhãesОценок пока нет

- GÁLATAS - MaxwellДокумент21 страницаGÁLATAS - MaxwellMaxwellОценок пока нет

- Ebook Equipamentos Guitarrista Sincero YTДокумент32 страницыEbook Equipamentos Guitarrista Sincero YTAlvaroОценок пока нет