Академический Документы

Профессиональный Документы

Культура Документы

Capitulo 6

Загружено:

Lucas MosqueraОригинальное название

Авторское право

Доступные форматы

Поделиться этим документом

Поделиться или встроить документ

Этот документ был вам полезен?

Это неприемлемый материал?

Пожаловаться на этот документАвторское право:

Доступные форматы

Capitulo 6

Загружено:

Lucas MosqueraАвторское право:

Доступные форматы

Captulo 6

Anlisis de Regresin Simple

El anlisis de regresin lineal, en general, nos permite obte-

ner una funcin lineal de una o ms variables independientes o

predictoras (X1, X2, ... XK) a partir de la cual explicar o predecir

el valor de una variable dependiente o criterio (Y). En el anlisis

de regresin lineal podemos diferenciar entre anlisis de regre-

sin lineal simple y anlisis de regresin lineal mltiple. En el pri-

mero, se intenta explicar o predecir la variable dependiente (Y) a

partir de una nica variable independiente, (X1); mientras que en

el segundo, contamos con un conjunto de variables indepen-

dientes, (X1, X2, ... XK), para estimar la variable dependiente (Y).

En ambos casos, tanto la variable dependiente como la/s inde-

pendiente/s estn medidas en escala de intervalo o de razn.

En este captulo nos vamos a ceir al anlisis de regresin

lineal simple posponiendo para el prximo captulo la regresin

lineal mltiple que, como tendremos ocasin de apreciar, com-

parte mucho de lo que en estas lneas se recoge. El anlisis de

regresin lineal simple tiene por finalidad predecir y/o estimar

los valores de la variable dependiente a partir de la obtencin de

la funcin lineal de la variable independiente. La anotacin mate-

mtica de la ecuacin de regresin simple se anota como sigue:

Y = a + b1x1 + e

presente = a + b1pasado + e

en donde:

Y es la variable a predecir;

a y b1X1 son parmetros desconocidos a estimar;

y e es el error que cometemos en la prediccin de los par-

metros.

No obstante, antes de proceder a la estimacin de los par-

metros, y con ellos a la concrecin de una ecuacin predictiva,

debemos corroborar que, efectivamente, los datos sometidos a

Cap t ul o 6

Anl i s i s de Regres i n Si mpl e

Estadstica Informtica: casos y ejemplos con el SPSS 91 91

1. Introduccin

Captulo 6

Anlisis de Regresin Simple

Cap t ul o 6

Anl i s i s de Regres i n Si mpl e

Estadstica Informtica: casos y ejemplos con el SPSS 92

anlisis se adaptan a un modelo de regresin lineal. La leccin la

hemos estructurado en los siguientes puntos:

1. Exposicin de los estadsticos que nos permiten valora-

cin de la bondad de ajuste de los datos al modelo de

regresin lineal simple.

2. Si los estadsticos certifican que entre los datos se produ-

ce una asociacin lineal, podremos pasar a estimar los

parmetros de la ecuacin lineal (B0 y B1), a partir de los

cuales podremos efectuar predicciones de la variable

dependiente. Cabe advertir que en el supuesto caso en el

que los estadsticos rechazaran la asociacin lineal entre

los datos, no significa que entre ellos se produzca otro

tipo de relacin (como la curvilnea).

3. Por ltimo, exponemos la secuencia de pasos que nos

permiten determinar lo arriba apuntado. En el anlisis de

regresin simple, y con la finalidad de obtener la mayor

informacin posible respecto a la relacin y asociacin

entre las dos variables, vamos a trabajar con tres Cuadros

de Dilogos, a saber: Cuadro de Dilogo de

Correlaciones Bivariadas. Cuadro de Dilogo de

Grficos; y Cuadro de Dilogo del Anlisis de Regresin

Lineal Mltiple.

Antes de poder aplicar el modelo de regresin lineal simple

para predecir los valores que alcanzar una determinada variable

criterio, debemos certificar que los datos a los que sometemos a

dicho anlisis se ajustan al modelo de regresin lineal simple; o

lo que es lo mismo, debemos analizar el grado de asociacin

lineal entre la variable dependiente y la independiente as como

determinar la proporcin de variabilidad de la variable depen-

diente explicada por la independiente.

Los principales estadsticos y pruebas que nos permiten valo-

ra la bondad de ajuste de los datos al modelo de regresin lineal

simple son.

1.- Coeficiente de Correlacin Lineal Simple (r).

Mide el grado de asociacin lineal entre dos variables. Este

estadstico oscila entre 1 (fuerte asociacin lineal positiva: a medi-

2. Bondad de ajuste de los datos al modelo de regresin line-

al simple

da que aumenten los valores de una variable aumentarn los de

la otra) y 1 (fuerte asociacin lineal negativa: a medida que

aumenten los valores de una variable disminuyen los de la otra).

Cuando los valores de este estadstico se aproximen a 0 nos esta-

r indicando que entre las dos variables no existe asociacin line-

al y, en consecuencia, carece de sentido determinar el modelo

y/o ecuacin de regresin lineal. Resulta muy interesante com-

parar este coeficiente junto con el Scatter Plot de la nube de pun-

tos (grfico 1 del anexo de resultados), ya que el grfico nos ofre-

ce una representacin elocuente de la distribucin y relacin de

las dos variables relacionadas. Si la nube de puntos forma una

forma indefinida y muy dispersa, nos indica la inexistencia de

relacin entre las variables. Si por el contrario, se observa una

forma definida y proximidad entre los puntos, habr relacin

entre las variables caracterizada por la forma y distribucin que

adopte.

Para determinar si la asociacin es estadsticamente significa-

tiva podemos contrastar la H0 de que el coeficiente de correlacin

lineal es igual a 0; o lo que es lo mismo, que las dos variables

estn incorrelacionadas. Si el p-valor asociado al estadstico de

contraste (r) es menor que el nivel de significacin elegido (nor-

malmente 0.05) rechazaremos H0. En la matriz de correlaciones

se recogen estos dos valores: en primer lugar aparece el grado

de relacin (r) que se produce entre las dos variables que cruza-

mos; y en segundo lugar, la significacin estadstica de esa rela-

cin.

Debemos hacer notar que pese a que estemos efectuando un

anlisis de regresin lineal bivariado, el proceso que seguimos es

el del anlisis de regresin multivariable. El cuadro de dilogo del

anlisis multivariado ofrece una informacin ms rica de ah la

tendencia generalizada a utilizar ste en detrimento del cuadro de

dilogo de regresin simple. Por esta razn, vamos a ver como

en las salidas del ordenador, y pese a estar realizando un anlisis

con dos variables, a este coeficiente se le denomina coeficiente

de Correlacin Mltiple (Multiple R), residiendo la explicacin

en el hecho de que va a ser siempre el anlisis multivariable el

que apliquemos indistintamente si nos encontramos trabajando

con dos variables, como es ahora el caso, o con ms variables,

como se ver en el prximo captulo. No debemos confundir el

coeficiente de correlacin mltiple (mide el grado de asociacin

entre la variable dependiente y un conjunto de variables inde-

Cap t ul o 6

Anl i s i s de Regres i n Si mpl e

Estadstica Informtica: casos y ejemplos con el SPSS 93 93

Cap t ul o 6

Anl i s i s de Regres i n Si mpl e

Estadstica Informtica: casos y ejemplos con el SPSS 94

pendientes), de los coeficientes de correlacin lineal simple (apa-

recen en la matriz de correlaciones).

2.- Coeficiente de Correlacin Mltiple al Cuadrado o

Coeficiente de Determinacin (R Square R

2

).

El coeficiente de determinacin se define a partir del coefi-

ciente de correlacin mltiple (R) y mide la proporcin de varia-

bilidad de la variable dependiente explicada por la variable inde-

pendiente introducida o por la recta de regresin. Si el valor que

resulta lo multiplicamos por 100, obtendremos el porcentaje de

variabilidad explicada.

3.- Coeficiente de Determinacin Ajustado (Adjusted R

Square).

Pese a que R

2

se viene utilizando como medida de ajuste al

modelo, presenta el inconveniente de que a medida que vamos

incrementando el nmero de variables que participan en el

modelo (ser el caso propio del anlisis multivariable) mayor es

su valor de ah que la R

2

sobrestime el verdadero R de la pobla-

cin. Por esta razn, algunos autores recomiendan utilizar el

Coeficiente de Determinacin Ajustado pues ste no aumenta,

necesariamente, a medida que aadimos variables a la ecuacin.

Este estadstico queda ajustado por el nmero de observaciones

y el nmero de variables independientes incluidas en la ecuacin.

4.- Error Tpico de Prediccin (ETB).

El error tpico de la prediccin es la parte de la variable

dependiente que dejamos de explicar ya sea porque nos falte

alguna variable por introducir, o bien, porque las variables que

hemos elegido no son las ms adecuadas. Su clculo se estable-

ce a partir de la desviacin tpica de la variable dependiente y el

coeficiente de determinacin ajustado.

5.- Anlisis de Varianza.

La tabla de anlisis de varianza que incluye en su salida el

SPSS nos permite valorar hasta qu punto es adecuado el mode-

lo de regresin lineal para estimar los valores de la variable

dependiente. La tabla de anlisis de varianza se basa en que la

variabilidad total de la muestra puede descomponerse entre la

variabilidad explicada por la regresin y la variabilidad residual.

La tabla de ANOVA proporciona el estadstico F a partir del cual

podemos contrastar la H0 de que R

2

es igual a 0, la pendiente de

la recta de regresin es igual a 0, o lo que es lo mismo, la hip-

tesis de que las dos variables estn incorrelacionadas. Si el p-

valor asociado al estadstico F es menor que el nivel de signifi-

cacin (normalmente 0.05), rechazaremos la hiptesis nula plan-

teada.

6.- Anlisis de Residuales.

Como ya hemos comentado los residuos, e, son la esti-

macin de los verdaderos errores. En regresin lineal la distribu-

cin de la variable formada por los residuos debe ser Normal,

esto es, los residuos observados y los esperados bajo hiptesis de

distribucin normal deben ser parecidos. Adems, los residuos

deben ser independientes. En consecuencia, el anlisis de los

residuales nos va a permitir no solo profundizar en la relacin

que se produce entre las dos variables, sino tambin, ponderar la

bondad de ajuste de la regresin obtenida.

Para contrastar la supuesta normalidad de los residuales

podemos recurrir, fundamentalmente, a la representacin de dos

grficos: (1) el grfico de residuales tipificados (grfico 2 del

anexo de resultados) nos da idea de cmo se distribuyen los resi-

duos en relacin a la distribucin normal (que sera la que cabra

esperar de los mismos). Si ambas distribuciones son iguales (la

distribucin de los residuos es normal) los puntos se sitan sobre

la diagonal del grfico. Por lo contrario, en la medida que apare-

cen dispersos y formando lneas horizontales respecto a la dia-

gonal, habr ms residuos y el ajuste ser peor; (2) el grfico de

probabilidad normal (grfico 3 del anexo de resultados) compa-

ra grficamente, al superponer la curva de distribucin normal, la

funcin de distribuciones acumulada observadas en la muestra

con la funcin de distribucin acumulada esperada bajo supues-

tos de normalidad.

Por su parte el estadstico de Durbin-Watson mide el grado

de autocorrelacin entre el residuo correspondiente a cada obser-

vacin y el anterior (si los residuos son independientes, el valor

observado en una variable para un individuo no debe estar

influenciado en ningn sentido por los valores de esta variable

observados en otro individuo). Si el valor del estadstico es pr-

ximo a 2 los residuos estn incorrelacionados; si se aproxima a

4, estarn negativamente incorrelacionados; y si se aproximan a

0 estarn positivamente incorrelacionados.

Cap t ul o 6

Anl i s i s de Regres i n Si mpl e

Estadstica Informtica: casos y ejemplos con el SPSS 95 95

Cap t ul o 6

Anl i s i s de Regres i n Si mpl e

Estadstica Informtica: casos y ejemplos con el SPSS 96

Una vez que ya hemos analizado el carcter e intensidad de

la relacin entre las variables, podemos proceder a estimar los

parmetros de la ecuacin de prediccin o de regresin lineal. El

criterio para obtener los coeficientes de regresin B0 y B1 es el de

mnimos cuadrados. Este consiste en minimizar la suma de los

cuadrados de los residuos de tal manera que la recta de regresin

que definamos es la que ms se acerca a la nube de puntos

observados y, en consecuencia, la que mejor los representa.

Los estadsticos asociados a la variable independiente que ha

pasado a formar parte del modelo de regresin simple son:

1.- Coeficiente de regresin B.

Este coeficiente nos indica el nmero de unidades que

aumentar la variable dependiente o criterio por cada unidad que

aumente la variable independiente.

2.- SEB.

Error tpico de B.

3.- Coeficiente Beta.

El coeficiente Beta es el coeficiente de regresin estandariza-

do. Expresa la pendiente de la recta de regresin en el caso de

que todas las variables estn transformadas en puntuaciones Z.

4.- Constante.

El valor de la constante coincide con el punto en el que la

recta de regresin corta el eje de ordenadas. En la ecuacin de

prediccin se mantiene constante para todos los individuos.

Cuando las variables han sido estandarizadas (puntuaciones Z) o

si se utilizan los coeficientes Beta, la constante es igual a 0 por

lo que no se incluye en la ecuacin de prediccin.

5.- Tolerancia.

Tolerancia es la proporcin de variabilidad no explicada por

el resto de variables (1-R

2

). Cuanto mayor sea la T ms indepen-

diente es la variable en cuestin.

3. Estimacin de los parmetros o coeficientes de regresin:

la ecuacin de prediccin o ecuacin de regresin simple

6.- Valor T.

El estadstico T nos permite comprobar si la regresin entre

una variable independiente y la dependiente es significativa. Si el

p-valor asociado al estadstico T (Sig T) es mayor al nivel de sig-

nificacin (normalmente 0.05) rechazaremos que la regresin

sea significativa para las dos variables relacionadas.

En nuestro caso la significacin del estadstico T asociado al

modelo generado con la nica variable independiente que dis-

ponemos es inferior a 0.05 de ah que podamos ratificar el carc-

ter predictivo de dicha variable y podamos, en consecuencia,

exponer la ecuacin del modelo. En el ejemplo que recogemos

en la seccin de Resultados, la transcripcin de los resultados a

la ecuacin quedara como sigue:

Y = a + b1x1 + e

presente (p7A) = 0,51 + 0,87pasado (p7B) + e

en el supuesto caso de que los valores de las variables siguieran

una escala diferente, tendramos que estandarizar utilizando los

coeficientes Beta, y no B. Del mismo modo, al contar con la

misma escala la constante ser cero.

presente (p7A) = 0 + 0,87pasado (p7B) + e

Una vez expuestos, desde un punto de vista terico, los prin-

cipales elementos que debemos considerar a la hora de abordar

una anlisis de regresin simple, su obtencin informtica parte

de la consideracin de tres cuadros de dilogos. Este proceso,

como tenderemos ocasin de apreciar, se simplifica en el anli-

sis de regresin mltiple.

El primer paso a desarrollar consiste en determinar la efecti-

va y real relacin lineal entre dos variables; esto es, debemos

contar con la matriz de correlaciones. Para ello, en primer lugar,

debemos elegir las dos variables que van a participar en la rela-

cin bivariada.

1

er

paso: Para poder seleccionar las dos variables seguiremos

la secuencia Analizar: Correlaciones: Bivariadas (figura 1).

Cap t ul o 6

Anl i s i s de Regres i n Si mpl e

Estadstica Informtica: casos y ejemplos con el SPSS 97 97

4. Cuadro de Dilogo de Correlaciones Bivariadas

Figura 1

Cap t ul o 6

Anl i s i s de Regres i n Si mpl e

Estadstica Informtica: casos y ejemplos con el SPSS 98

2 paso: Una ver en el Cuadro de Dilogo de correlaciones

bivariadas seleccionaremos de la lista de variables las dos que

nos interese relacionar. La seleccin deber pasar al cuadro situa-

do a la derecha (figura 2). En el ejemplo que reproducimos,

hemos seleccionado las variables continuas p7A SITUACIN

ACTUAL ESPAOLA (variable dependiente o criterio) y p7B

SITUACIN ESPAOLA PASADA (variable independiente o

predictora).Para valorar la relacin y el ajuste de los datos al

modelo de regresin debemos seleccionar, en el mismo cuadro

de dilogo, el Coeficiente de Correlacin de Pearson y las

Correlaciones significativas con una Prueba de Significacin

Bilateral.

3

er

paso: Para valorar la bondad de ajuste de los datos pode-

mos acompaar al coeficiente seleccionado de su correspon-

diente Scatter Plot. Dicho grfico lo podemos seleccionar en

Grficas: Dispersin: Simple (figuras 3 y 4).

4 paso: Una vez en el cuadro de dilogo del Diagrama de

dispersin simple (figura 5) debemos indicar la variable depen-

diente colocndola en el Eje Y as como la variable indepen-

diente situndola, en este caso, en el cuadro del Eje X. En este

grfico de dispersin de los valores X contra los de Y se observa

la fuerza, direccin y forma de la relacin entre las variables.

En el ejemplo que reproducimos, hemos seleccionado las

variables continuas p7A SITUACIN ACTUAL ESPAOLA

(variable dependiente o criterio) y p7B SITUACIN ESPAOLA

PASADA (variable independiente o predictora). El grfico de dis-

persin es el que aparece en el grfico 1 que figura en el anexo

de resultados. De su anlisis podemos comprobar que en efecto

existe relacin entre las dos variables seleccionadas. La nube de

puntos tiene una forma definida y los puntos se encuentran, ms

o menos, agrupados.

En la introduccin del captulo hemos presentado a los an-

lisis de varianza y de residuales, como dos buenos criterios para

valorar la bondad de ajuste de los datos al modelo de regresin

Figura 2

Figura 3

Figura 4

5. Cuadro de Dilogo de Grficos de Dispersin

6. Cuadro de Dilogo del Anlisis de Regresin Lineal

lineal. Estos anlisis, as como los estadsticos R, R

2

, R

2

Ajustada

y Error Tpico, solo se obtienen desde el Cuadro de Dilogo del

Anlisis de Regresin Lineal, el cual, se convierte en el cuadro

especfico del anlisis de regresin mltiple al permitirnos selec-

cionar ms de una variable independiente. A partir de ahora, y

como ya hemos comentado, el Anlisis de Regresin Bivariado,

sigue el mismo procedimiento, como veremos ms adelante, que

el Anlisis de regresin Mltiple. Lo nico que va a cambiar es

la eleccin del nmero de variables con las que vamos a trabajar.

Por lo tanto, las salidas de ambos anlisis ser la misma.

Para completar la informacin respecto a la relacin que se

produce entre las dos variables debemos solicitarla, pues, en el

Cuadro de Dilogo correspondiente al Anlisis de Regresin

Lineal.

5

er

paso: Al cuadro de dilogo se llega siguiendo la secuen-

cia Analizar: Regresin: Lineal (figura 6).

6 paso: Una vez en l, deberemos especificar e introducir

en sus correspondientes cuadros, la variable dependiente y la

variable independiente (figura 7). Aqu nuevamente la variable

p7A SITUACIN ACTUAL ESPAOLA har las veces de varia-

ble dependiente o criterio y p7B SITUACIN ESPAOLA

PASADA de variable independiente o explicativa.

7 paso: Cliqueando sobre el botn de comando

Estadsticas, situado en la parte inferior del cuadro de dilogo

principal, podremos (figura 8): obtener el estadstico Durbin-

Watson, que nos permite realizar el anlisis sobre los Residuos;

los estadsticos Descriptivos bsicos, que podremos utilizar en la

interpretacin y anlisis de la relacin (entre los que destaca la

Matriz de Correlaciones para analizar la relacin y significacin);

los estadsticos que nos permiten valorar el Ajuste del modelo (R,

R

2

, R

2

Corregida y el error tpico de la estimacin); por defecto,

y tambin como criterio de validacin del modelo nos presenta el

anlisis de varianza; y, por ltimo, solicitaremos que nos calcule

las Estimaciones de los Coeficientes de regresin, lo que nos

permitir concretar la ecuacin predictiva.

8 paso: Como complemento al estadstico de Durbin-

Watson cliqueando en el botn de Grficos del cuadro de dilo-

go principal de regresin lineal podremos solicitar los grficos

Histograma y Grfico de Probabilidad Normal (figura 9).

Cap t ul o 6

Anl i s i s de Regres i n Si mpl e

Estadstica Informtica: casos y ejemplos con el SPSS 99

Figura 5

Figura 6

Figura 7

Figura 8

Cap t ul o 6

Anl i s i s de Regres i n Si mpl e

Estadstica Informtica: casos y ejemplos con el SPSS 100

Los hechos y fenmenos sociales, complejos por naturaleza,

son explicados no por una nica causa sino por una pluralidad

de ellas. Con la revolucin informtica se consolida la perspecti-

va del anlisis multivariable relegando a un segundo plano el

enfoque univariado del que el anlisis de regresin simple forma

parte. La aplicacin de esta tcnica, tal y como hoy es concebi-

da y aplicada la investigacin en ciencias sociales, se cie a dar

respuesta puntual de alguna cuestin formando parte de una

estrategia global de investigacin. En este apartado recogemos

cmo es aplicado este anlisis en un aspecto muy puntual del

anlisis demogrfico.

Dez Nicols, Juan (1997): La estructura de los hogares

espaoles, en Rafael Puyol (ed.) (1997), Dinmica de la pobla-

cin en Espaa. Cambios demogrficos en el ltimo cuarto del

siglo XX, Madrid, Sntesis, pp. 145-166.

El captulo, entre otras muchas consideraciones, analiza

la reduccin del tamao promedio de los hogares espa-

oles. Con el objetivo de de comprobar si es la baja

fecundidad o el alto nmero de hogares unipersonales

el factor que ms influye en el tamao promedio de los

hogares se ha aplicado un anlisis de regresin simple

tomando como unidad de anlisis los 12 paises de la

Unin Europea (este anlisis tambin se ha aplicado

para el conjunto de CCAA). Se ha comprobado que la

correlacin entre el ndice de fecundidad y el tamao

medio de hogares es muy baja y negativa (r = -0.02);

mientras que la correlacin entre la proporcin de hoga-

res unipersonales sobre el total y el tamao medio de

los hogares es muy alta y tambin negativa (r= -0.90).

El anlisis ha demostrado que tanto para la Unin

Europea como para el conjunto de CCAA, el tamao

medio de los hogares depende ms de la proporcin de

hogares unipersonales que de la fecundidad en el senti-

do de que cuanto mayor el la proporcin de hogares

unipersonales sobre el total de hogares de una sociedad

ms pequeo es el tamao medio de los hogares. Lo

que explica la reduccin del tamao en los hogares en

Figura 9

7. Bibliografa Comentada

la actualidad no es la baja fecundidad, sino el incre-

mento en la proporcin de hogares unipersonales.

En el anexo que sigue se recogen las salidas de resultados

que el paquete estadstico SPSS ofrece cuando es la tcnica de

regresin simple la que se ha aplicado.

En primer lugar, el programa nos ofrece una tabla y un

grfico que dan cuenta de la bondad de ajuste de los

datos al modelo de regresin simple: la tabla en donde

aparece la matriz de correlaciones (cuadro de dilogo de

correlacin bivariada); y el grfico scatter plot (del cuadro

de dilogo de grficas de dispersin).

A continuacin se presentan el resto de tablas y grficos obte-

nidos a partir de las restricciones impuestas en el cuadro de di-

logo de regresin lineal (el que aplicaremos en el anlisis de

regresin mltiple).

De este modo, se exponen las tablas que recogen infor-

macin bsica tanto del proceso como de las variables

sometidas a anlisis; esto es, la tabla de descriptivos bsi-

cos y la de matriz de correlaciones parciales.

A continuacin se presenta una tabla (resumen del mode-

lo) en la que se relaciona una serie de estadsticos a par-

tir de los cules valorar la bondad de ajuste de los datos

del modelo. Con la misma finalidad se presenta la tabla

de anlisis de varianza. Incluye el estadstico Durbin-

Watson que nos permite analizar la independencia de los

residuales. Estas tablas, y los estadsticos adscritos a las

mismas, complementan la informacin ya aportada en

las primeras tablas de informacin.

En tercer lugar, nos encontramos con la tabla en la que

aparecen los coeficientes de la ecuacin predictiva. sta

se forma a partir de los coeficientes no estandarizados (B)

cuando los valores de las dos variables tienen la misma

escala. En el caso contrario deberemos elegir los coefi-

cientes Beta.

Cap t ul o 6

Anl i s i s de Regres i n Si mpl e

Estadstica Informtica: casos y ejemplos con el SPSS 101

8. Resultados

Cap t ul o 6

Anl i s i s de Regres i n Si mpl e

Estadstica Informtica: casos y ejemplos con el SPSS 102

Por ltimo, la exposicin de resultados se cierra con dos

representaciones grficas cuya finalidad es facilitar el an-

lisis respecto al tipo de distribucin de los residuales: gr-

fico de residuos tipificados y grfico de probabilidad nor-

mal.

8.1. Matriz de Correlaciones (Cuadro de dilogo de

Correlaciones bivariadas)

8.2. Grfico de Dispersin (Cuadro de dilogo de Grficos de

Dispersin) (Grfico 1).

Cap t ul o 6

Anl i s i s de Regres i n Si mpl e

Estadstica Informtica: casos y ejemplos con el SPSS 103

8.3. Estadsticos bsicos (Cuadro de dilogo de Regresin Lineal)

8.4. Matriz de Correlaciones Parciales

8.5. Resumen del proceso STEPWISE: relacin y eliminacin de

variables

8.6. Estadsticos de Bondad de Ajuste

Cap t ul o 6

Anl i s i s de Regres i n Si mpl e

Estadstica Informtica: casos y ejemplos con el SPSS 104

8.7. Tabla de Anlisis de Varianza

8.8. Estimaciones de parmetros o coeficientes de correlacin: la

ecuacin de prediccin

8.9. Grafico de distribucin de residuales (grfico 2)

Cap t ul o 6

Anl i s i s de Regres i n Si mpl e

Estadstica Informtica: casos y ejemplos con el SPSS 105

8.9. Grafico de probabilidad normal (grfico 3)

Вам также может понравиться

- Ejercicio Asientos PDFДокумент3 страницыEjercicio Asientos PDFverdinq167767% (12)

- Ejercicio Clasificación Geomecánica RMR Q GSIДокумент10 страницEjercicio Clasificación Geomecánica RMR Q GSIeever bruce0% (1)

- Sistema Contable en ExcelДокумент42 страницыSistema Contable en ExcelRiver Vega Córdova50% (2)

- Taller Construyendo Mi EmpresaДокумент2 страницыTaller Construyendo Mi EmpresaLucas MosqueraОценок пока нет

- Portafolio Actualizado 12 - 08 - 13 PDFДокумент23 страницыPortafolio Actualizado 12 - 08 - 13 PDFLucas MosqueraОценок пока нет

- Guc3ada de Aprendizaje Unidad 1Документ5 страницGuc3ada de Aprendizaje Unidad 1Lucas MosqueraОценок пока нет

- Sistema Contable en ExcelДокумент42 страницыSistema Contable en ExcelRiver Vega Córdova50% (2)

- Planilla de Excel de Calculo de Retorno Esperado en AccionesДокумент3 страницыPlanilla de Excel de Calculo de Retorno Esperado en AccionesLucas MosqueraОценок пока нет

- Catalogo de Cuentas Niif Pymes PDFДокумент16 страницCatalogo de Cuentas Niif Pymes PDFCesar Rafael Barrera BenavidesОценок пока нет

- 8898 Presupuesto Ingresos y Gastos 2013Документ7 страниц8898 Presupuesto Ingresos y Gastos 2013Lucas MosqueraОценок пока нет

- Avaluos de NiifДокумент35 страницAvaluos de NiifLucas Mosquera100% (2)

- Introduccion Soportes ContablesДокумент7 страницIntroduccion Soportes ContablesLucas MosqueraОценок пока нет

- TallasДокумент2 страницыTallasLucas MosqueraОценок пока нет

- IEP SUMMA-MBA Especialidad en Direccion GeneralДокумент26 страницIEP SUMMA-MBA Especialidad en Direccion GeneralLucas MosqueraОценок пока нет

- Unidad 1 - Teletrabajo para DependientesДокумент72 страницыUnidad 1 - Teletrabajo para DependientesLucas MosqueraОценок пока нет

- Guía Del EstudianteДокумент10 страницGuía Del EstudianteAlexander Rodriguez CruzОценок пока нет

- Tipos de IDДокумент4 страницыTipos de IDLucas MosqueraОценок пока нет

- Sopa de PastaДокумент2 страницыSopa de PastaLucas MosqueraОценок пока нет

- Clasificacion de RiesgosДокумент47 страницClasificacion de RiesgoshenryОценок пока нет

- Ensaladas para Bajar de Peso y Control de La Presion AltaДокумент5 страницEnsaladas para Bajar de Peso y Control de La Presion AltaLucas MosqueraОценок пока нет

- Baños Con CanelaДокумент1 страницаBaños Con CanelaLucas MosqueraОценок пока нет

- Capitulo1 PDFДокумент10 страницCapitulo1 PDFLucas MosqueraОценок пока нет

- Ejemplo Carta Residencia PDFДокумент1 страницаEjemplo Carta Residencia PDFLucas MosqueraОценок пока нет

- Derechos de GradoДокумент1 страницаDerechos de GradoLucas MosqueraОценок пока нет

- Competencias Laborales - ExposicionДокумент13 страницCompetencias Laborales - ExposicionyeikeiОценок пока нет

- Manual de Cobro Persuasivo y CoactivocolombiaaaДокумент46 страницManual de Cobro Persuasivo y CoactivocolombiaaaVictor Pedro Uturunco CondoriОценок пока нет

- Clasificacion de RiesgosДокумент47 страницClasificacion de RiesgoshenryОценок пока нет

- Práctica de PuntuaciónДокумент6 страницPráctica de PuntuaciónGloriaRodríguezChamorroОценок пока нет

- EjerciciosДокумент1 страницаEjerciciosLucas MosqueraОценок пока нет

- Decreto 2420 de 2015 Normas de Contabilidad, de Información Financiera y de Aseguramiento de InformaciДокумент11 страницDecreto 2420 de 2015 Normas de Contabilidad, de Información Financiera y de Aseguramiento de InformaciLucas MosqueraОценок пока нет

- Trabajomaquinadevapor10!3!100307194329 Phpapp01Документ25 страницTrabajomaquinadevapor10!3!100307194329 Phpapp01Lucas MosqueraОценок пока нет

- Observables DerivadasДокумент1 страницаObservables DerivadasMartin CabreraОценок пока нет

- Catálogo de Conceptos CDMXДокумент372 страницыCatálogo de Conceptos CDMXBlanca Oliver100% (2)

- PQ200v187 Manual EspanolДокумент142 страницыPQ200v187 Manual EspanolAbel Rivera CervantesОценок пока нет

- Presentación SDGДокумент5 страницPresentación SDGDaniel GutierrezОценок пока нет

- Fisica Semana n1Документ7 страницFisica Semana n1NARCIBO ZENOBIO TRELLES SALASОценок пока нет

- MEDIDA de La IntensidadДокумент5 страницMEDIDA de La IntensidadJuan NegretteОценок пока нет

- La Historia de La ElectricidadДокумент14 страницLa Historia de La ElectricidadAnonymous mwcN0Yi7Оценок пока нет

- Concentración de SolucionesДокумент3 страницыConcentración de SolucionesGabriel Torres MОценок пока нет

- Banco Preguntas Fluidos PP SPA2021Документ7 страницBanco Preguntas Fluidos PP SPA2021PEDRO ALEXANDER LEON SANDOVALОценок пока нет

- TesisI Marcio FinalgbfdgДокумент28 страницTesisI Marcio FinalgbfdgMarci AlexisОценок пока нет

- Manejo+Vocabulario+Contextual (2) Emelina Con R. 2Документ10 страницManejo+Vocabulario+Contextual (2) Emelina Con R. 2Fanny Morales LizamaОценок пока нет

- Primer Examen Parcial Modelos Probabilísticos Discretos SRДокумент13 страницPrimer Examen Parcial Modelos Probabilísticos Discretos SREsteban PeraltaОценок пока нет

- MaquinaДокумент5 страницMaquinaJuan Sebastian Londoño CardonaОценок пока нет

- Las Formas Del Siglo XX, Montaner, Josep María PDFДокумент410 страницLas Formas Del Siglo XX, Montaner, Josep María PDFJulio Gamero83% (6)

- Practicas de Electronica Malvino (Libre)Документ376 страницPracticas de Electronica Malvino (Libre)John Jairo Silva95% (19)

- Propiedades de La LuzДокумент5 страницPropiedades de La LuzRené ZavalaОценок пока нет

- Taichi 2Документ6 страницTaichi 2Claudio Nelson Estela100% (1)

- Aca Real Fundamentos de MatematicasДокумент9 страницAca Real Fundamentos de MatematicasJOHN FREDDY BEDOYA RAMIREZОценок пока нет

- MedElec v7Документ134 страницыMedElec v7danielОценок пока нет

- Ensayo CBRДокумент15 страницEnsayo CBRAndres Huaman PariapazaОценок пока нет

- Cromatografía de Papel, EspinacasДокумент14 страницCromatografía de Papel, EspinacasOmar Alex0% (1)

- Guia de Ejercicios de SoldaduraДокумент7 страницGuia de Ejercicios de SoldaduraTatuajes Zeros100% (6)

- Tema 4 - El Diodo IdealДокумент25 страницTema 4 - El Diodo IdealAntonio BustamanteОценок пока нет

- Taller 2.4 Aplicaciones de Movimeinto Acelerado.Документ3 страницыTaller 2.4 Aplicaciones de Movimeinto Acelerado.Luis Eduardo Quintana RinconОценок пока нет

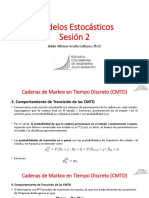

- Modelos Estocásticos Sesión 2Документ22 страницыModelos Estocásticos Sesión 2Juancho CorreaОценок пока нет

- Matriz de Peligros SenaДокумент10 страницMatriz de Peligros SenaLaura Maria Moreno LeonОценок пока нет