Академический Документы

Профессиональный Документы

Культура Документы

DTI - BigData - Analytics v1.0

Загружено:

Daniel FernándezОригинальное название

Авторское право

Доступные форматы

Поделиться этим документом

Поделиться или встроить документ

Этот документ был вам полезен?

Это неприемлемый материал?

Пожаловаться на этот документАвторское право:

Доступные форматы

DTI - BigData - Analytics v1.0

Загружено:

Daniel FernándezАвторское право:

Доступные форматы

MAESTRÍA EN DIRECCIÓN DE TECNOLOGÍA DE LA INFORMACIÓN

ASIGNATURA : Dirección de Tecnologías de Información

PROFESOR(ES) : Martín Santana

TÍTULO DEL TRABAJO : Big Data y Analytics

El presente trabajo ha sido realizado de acuerdo a los

Reglamentos de la Universidad ESAN por:

Carlos Roberto Sáenz Ruiz (1712107) ____________________

Segundo Javier Orrillo Abanto (1712702) ___________________

Christian Raul Zárate Araoz (1712715) ____________________

Fernando Martín Fernández Gómez (1713243) ____________________

Sammy Sam Puche (1606560) ____________________

Surco, 17 de mayo de 2019

Maestría en Dirección de Tecnologías de la Información

Contenido

1.- Resumen ejecutivo 3

2.- Marco conceptual 4

3.- Evolución histórica 7

4.- Descripción funcional 8

5.- Beneficios 10

6.- Principales proveedores 10

7.- Factores críticos de éxito para implementación 13

8.- Descripción de un caso de implementación exitosa en el Perú 14

9.- Proyección de avances tecnológicos en el futuro 16

10.- Conclusiones 17

11.- Bibliografía 18

Dirección de Tecnologías de Información 2

Maestría en Dirección de Tecnologías de la Información

1.- Resumen ejecutivo

El presente documento tiene como finalidad explicar los orígenes de Big Data y como se

puede aplicar analítica según el modelo que se pretende implementar. La aplicación de

Big Data dependerá mucho del caso de negocio que trace la alta dirección o hacia donde

lo quiere enfocar la empresa. Los beneficios de Big Data son amplios y esto se da en gran

parte a la variedad, velocidad, volumen y veracidad de los datos. Sus aplicaciones se dan

para mejorar la toma de decisiones en base a la calidad de información, mejorar la

fidelidad de los clientes, permite identificar tendencias y patrones a través de la

interpolación de datos para establecer comportamientos o tendencias y para generar

nuevos procesos de negocios para generar valor a la empresa. También se pretende

mencionar cuales son los principales proveedores y los factores críticos de éxitos que

pueden contribuir a su implementación.

Por último, se menciona dos casos de éxito de Big Data aplicados en el Perú dentro del

sector de Transporte publico urbano (AATE) y el sector financiero (BCP). Los escenarios

de la aplicación de Big Data tienen una amplia proyección, sin embargo, es importante

citar un informe realizado por IBM y la escuela de negocios de Oxford (2012) el cual nos

da un panorama del avance y aplicación de Big Data en el sector empresarial tomado de

una muestra de 1061 ejecutivos encuestados.

Imagen 1.1: Adopción de Big Data. Recuperado de: https://www-

05.ibm.com/services/es/gbs/consulting/pdf/El_uso_de_Big_Data_en_el_mund

o_real.pdf

En la imagen 1.1 se observa que el 47% de ejecutivos encuestados manifiesta que en sus

empresas ya existe una comprensión y acciones formales elaboradas respecto a la

Dirección de Tecnologías de Información 3

Maestría en Dirección de Tecnologías de la Información

importancia del Big Data en la toma de decisiones, sin embargo, carecen de

implementaciones, por otro lado, un 22% manifiesta que ya existen iniciativas de

implementación y validación de resultados. Solo el 6% manifiesta que ya se han

implementado 1 o dos proyectos de Big Datos en casos de negocio reales.

Si hablamos de obstáculos o desafíos, podemos citar la imagen 1.2, IBM Institute for

Business Value & Escuela de negocios de la universidad de Oxford (2012). El principal

desafío es que no existe casos de negocio realmente atractivos para poder dirigir una

implementación (transversal a todos los niveles de adopción) a esto se le suma la calidad

de los datos y habilidades técnicas y analíticas requeridas. Se espera que estos

escenarios mejoren con la implementación de más iniciativas.

Imagen 1.2: Desafíos de Big Data. Recuperado de: https://www-

05.ibm.com/services/es/gbs/consulting/pdf/El_uso_de_Big_Data_en_el_mund

o_real.pdf

2.- Marco conceptual

Big Data

Durante la primera década del siglo XXI, con la proliferación de equipos tecnológicos

capaces de emitir información hacia internet, la reducción de costos en hardware y la

masificación del acceso a internet ha ocasionado una alta generación de datos de diversa

índole. Ya sea mediante la emisión de información del estado de un equipo (estado de

hardware, información recolectada por sensor), o la interacción que una persona a través

Dirección de Tecnologías de Información 4

Maestría en Dirección de Tecnologías de la Información

de una aplicación (acceso a redes sociales, búsquedas en navegadores, compra de

productos o servicios, etc.).

Las grandes cantidades de datos generados continúa en aumento, medidos en unidades

de almacenamiento impensables hasta hace una década. Los Terabyte se volvieron un

valor nada asombroso y no es sorpresa conocer que grandes cadenas de supermercado

como Walmart cuenta con datos almacenados de hasta algunas unidades de Petabytes.

Imagen 2.1: Big Data - Infografía. Recuperado de: www.datos.gob.es

Aunque no existe consenso para definir Big Data, se suele brindar un acercamiento a

través de sus características que año tras año se van sumando inclusive hasta en el

presente año 2019. A inicios del 2011 Adrián Merv, vicepresidente de la consultora

Gartner definía a Big Data mediante las limitantes que se tenían para su procesamiento

en base al hardware y software de la época, una definición similar (en base a las

limitantes) era la brindaba por McKinsey Global Institute. La definición de Big Data en

base a la restricción fue cambiando hacia las características y diversos autores dan como

aceptadas las características denominadas ‘Tres V’: que refieren al Volumen (cantidad),

Velocidad (referente a la creación y tipo de procesamiento) y la Variedad (considerando

las diversas fuentes de emisión), con el tiempo fueron ganando aceptación dos

características adicionales como Veracidad (grado de calidad) y Valor (rentabilidad como

resultado).

Dirección de Tecnologías de Información 5

Maestría en Dirección de Tecnologías de la Información

Podemos definir a Big Data como el gran volumen de información generadas por diversos

dispositivos y almacenadas en diversos formatos que no pueden ser procesadas por la

tecnología de gestión de bases de datos estructurados.

Big Data Analytics (BDA)

Es el análisis de datos “Big Data” mediante el uso de tecnología y algoritmos matemáticos

que permite extraer patrones de comportamiento. El resultado de dicho análisis puede

clasificarse en:

BDA Descriptivo: Analizando los datos, explica lo sucedido en el pasado.

BDA Diagnóstico: Además de lo realizado en el BDA Descriptivo trata de explicar

el motivo del porqué sucedió.

BDA Predictivo: Analiza los datos para predecir lo que podría suceder.

BDA Prescriptivo: Además de Analizar datos y predecir, puede aconsejar en cómo

actuar ante un determinado evento.

Imagen 2.2: Big Data - Infografía. Recuperado de: www.dsssolutions.com

Dirección de Tecnologías de Información 6

Maestría en Dirección de Tecnologías de la Información

3.- Evolución histórica

Luis Joyanes, en su libro Big Data:

Análisis de Grandes Volúmenes de

Datos en Organizaciones, clasifica la

evolución histórica del Big Data en dos

etapas:

La primera etapa: Comprendida entre

los años 1984 y 2007. En el cual se hace referencia a los primeros usos del término

además de su expansión en el campo científico y en una forma muy primigenia hacia los

negocios, todo ello bajo un enfoque de conceptualización. Se utiliza como referencia el

año 1984 por el artículo de Charles Tilly denominado “The Old New Social History and the

New Old Social History” donde si bien se utiliza el término “Big Data” no está enfocado en

el contexto tecnológico tal como ahora se conoce. Para 1990, Peter Denning en su

artículo “Saving All the Bits” hace un acercamiento al concepto actual, hablando de

grandes flujos de datos y máquinas que pueden procesar esta información.

En 1997, Michael Cox and David Ellsworth publican en la ACM digital Library el artículo

“Application-controlled demand paging for out-of-core visualization”, este artículo contiene

el término Big Data donde hace referencia a los recursos para el procesamiento de datos.

En 1998, el científico John Mashey publica en The New York Times el artículo “Big Data…

and the Next Wave of Infrastress.”, Mashey utilizaba el término en sus diversos discursos

y por tal motivo algunos investigadores le dan el crédito de haber creado el término “Big

Data”.

En el año 2000, Francis Diebold publica el artículo “Big Data Dynamic Factor Models for

Macroeconomic Measurement and Forecasting”, en este artículo de expresa de manera

explícita por primera vez el término Big Data tal como ahora se lo conoce.

En 2001, Doug Laney de Meta Group (Gartner), publica el artículo “3D Data Management:

Controlling Data Volume, Velocity, and Variety.” En este artículo se hace referencia a las 3

primeras características que definen Big Data, las “Tres V”.

En 2005, Tim O'Reilly publica el artículo "¿Qué es la Web 2.0?" que desencadena en la

actual ruta que actualmente es Big Data. En este mismo año, Yahoo crea Hadoop...

La segunda Etapa: comprende desde el año 2008 hasta la actualidad y hace referencia a

la utilización del término en el ámbito tecnológico y económico, pasa de una referencia de

conceptualización hacia un enfoque aplicado a través de herramientas para el beneficio

de las organizaciones. A partir de esta fecha además se desarrollaron las múltiples

Dirección de Tecnologías de Información 7

Maestría en Dirección de Tecnologías de la Información

plataformas (Redes Sociales, masificación de Smartphones, Internet de las cosas,

etcétera) que permiten la generación de datos que comprende Big Data.

4.- Descripción funcional

Big data & Analytics son dos tecnologías emergentes que se complementan mutuamente.

Por un lado, la primera se refiere, por definición, a la recopilación, almacenamiento y

tratamiento de gran cantidad de datos, que cumplen principalmente con las siguientes

características:

Velocidad: Son generados continuamente, cada minuto, segundo e incluso

intervalos menores. A diferencia de las bases de datos tradicionales, estos datos

son generados en todo momento por las distintas fuentes de análisis, tales como

cámaras de video, redes sociales, entre otras.

Volumen: La cantidad es elevada, gigabytes o terabytes de información, que son

generados en tiempos bastante reducidos, y que pueden ser almacenados para su

respectivo tratamiento y análisis.

Variabilidad: Se trata de datos estructurados y no estructurados, los cuales

muchas veces ni siquiera son predecibles. A diferencia de los sistemas de

inteligencia de negocio típicos, en el caso de Big data, no siempre se sabe lo que

se está almacenando, pues mediante tecnología se descubre dicha información.

Veracidad: Los datos son relevantes y sin sesgo en relación con el objetivo del

análisis. Si bien es cierto que se trata de gestionar volúmenes de datos elevados,

se debe verificar que sean relevantes y veraces para el objetivo del estudio.

Adicionalmente, en relación con Analytics, podemos mencionar que se trata de utilizar

tecnología de análisis, para generar información de valor para la organización.

Generalmente, este análisis se hace sobre Big data y a diferencia de los sistemas de

inteligencia de negocios, suelen ser los algoritmos los que permiten al analista descubrir

información. No necesariamente se sabe a priori que información se encontrará al aplicar

dicha tecnología. En tal sentido, podemos indicar que las tecnologías de Analytics son las

que permiten aprovechar todos los datos gestionados en una plataforma de Big data.

Dirección de Tecnologías de Información 8

Maestría en Dirección de Tecnologías de la Información

Con la finalidad de comprender mejor las tecnologías mencionadas, a continuación,

mencionaremos los componentes a nivel de arquitectura, de una solución de Big Data y

Analytics:

a) Fuentes: Se trata de los orígenes de los datos. Pueden ser bases de datos,

repositorios de archivos, redes sociales, páginas web, cámaras de video, entre

otras. No necesariamente generan datos estructurados.

b) Capa de almacenamiento: Componentes tecnológicos utilizados para almacenar

los datos generados en las distintas fuentes de datos. Por lo general, se utiliza la

base de datos Hadoop, la misma que permite gestionar datos estructurados y no

estructurados.

c) Capa de Análisis: Se trata de los componentes tecnológicos que contienen los

algoritmos para descubrimiento de datos, identificación de patrones, entre otros.

Su finalidad es generar información de valor, que luego será presentada al analista

para la toma de decisiones.

d) Capa de Consumo: Es la capa en la cual se generan los gráficos, que resumen el

análisis de datos realizado. En esta capa, se encuentran los reporteadores que

usualmente conocemos y que permiten mostrar los resultados al usuario final de

los mismos.

Dirección de Tecnologías de Información 9

Maestría en Dirección de Tecnologías de la Información

Imagen 4.1: Componentes de una solución Big Data. Elaboración propia.

5.- Beneficios

Eficiencia en la toma de decisiones, pues se dispondrá de mejor información. No

se tendrá una visión sesgada del alcance de los sistemas que tenga la

organización, sino que se podrá descubrir aspectos relevantes a partir de fuentes

de datos que antes no habían sido analizadas.

El tener mayor información, permitirá conocer mejor a los clientes, lo cual permitirá

desarrollar modelos de fidelización efectivos, que se traducirán en mayores

ingresos para la compañía, mediante la retención y satisfacción de los clientes.

La empresa se transformará en una organización proactiva y propositiva. A

diferencia de las tecnologías tradicionales, que nos permitían analizar el pasado y

a partir de ahí evitar repetir errores, Big Data permite proponer acciones a partir de

la identificación de patrones de comportamiento, obtiendo ratios de conversión a

venta elevados.

Crear nuevos procesos de negocio, orientados hacia una transformación digital, que

permita gestionar con mayor eficiencia los recursos de la empresa. Las oportunidades que

se identifican mediante este análisis requerirán de un equipo humano que las lleve a la

realidad, lo cual es una oportunidad de mejora para la organización.

6.- Principales proveedores

Las ventas en el mercado global de Big Data y Analytics para este año 2019 se esperan

que alcancen los 189 billones USD, representando un crecimiento de 12% frente al 2018.

Con una proyección de crecimiento a doble dígito, para el 2022 se estima que las ventas

alcanzarán la cifra de 274 billones USD.

Dirección de Tecnologías de Información 10

Maestría en Dirección de Tecnologías de la Información

Del total de ventas, casi el 70% son soluciones basadas localmente, u on-premise,

mientras que el 30% restante son soluciones en cloud. Sin embargo, se espera que para

el 2022 las soluciones en la nube alcancen el 44% del mercado.

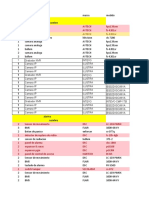

Como proveedores de la tecnología de Big Data y Analytics debemos considerar los 3

frentes de productos/servicios que ésta comprende: Hardware o Infraestructura, Software,

y Servicios, donde existen empresas que abarcan todos o parte de ellos. En la imagen 6.1

mostramos algunas de las principales empresas en función al volumen de sus ventas y en

la imagen 6.2 se presenta el detalle de las ventas distribuidas por el tipo de producto o

servicio que se ofrecen.

Imagen 6.1 - Ventas Anuales - Network World, Wikibon

Dirección de Tecnologías de Información 11

Maestría en Dirección de Tecnologías de la Información

Imagen 6.2 - Ventas por Tipo de Producto/Servicio - Network World, Wikibon

Es importante considerar que Big Data y Analytics representan entre el 1% y el 20% de

las ventas en las empresas mencionadas. Por ello resulta útil presentar otras empresas

cuyo enfoque es principalmente en esta tecnología, representando más del 90% de sus

ventas y operaciones, las cuales se muestran en la Imagen 6.3

Dirección de Tecnologías de Información 12

Maestría en Dirección de Tecnologías de la Información

Imagen 6.3 - Ventas de Software y Servicios Big Data - Wikibon

7.- Factores críticos de éxito para implementación

Se ha identificado los siguientes temas a considerar, como los más importantes para una

implementación de Big Data & Analytics satisfactoria:

7.1 Entendimiento y Aceptación del Big Data. La implementación de esta tecnología

producirá varios cambios en la Organización y a la vez varios beneficios. La alta dirección

debe estar consciente de ello y apoyar el proyecto, de tal forma que sea aceptado por

todos los niveles y se puedan entrenamientos de forma productiva.

7.2 Evitar la confusión por la variedad de Tecnologías de Big Data. Es fácil perderse

entre tanta información de tecnologías y soluciones de Big Data y tomar una decisión. Es

recomendable contar con una asesoría adecuada de expertos y definir una estrategia de

selección de recursos y herramientas que puedan añadir el valor que se espera a los

objetivos del Negocio

7.3 Definir una arquitectura de la Solución adecuada: De esto dependerán los costos

en que se incurra este proyecto, desde hardware, contratación o subcontratación de

personal especializado según los recursos a emplear, licencias de software, etc.Muchas

Dirección de Tecnologías de Información 13

Maestría en Dirección de Tecnologías de la Información

veces por un tema de costos que exceden lo esperado, los proyectos no acaban y

terminan siendo un desperdicio de dinero y recursos

7.4 Establecer una estrategia de gestión de la calidad de los datos: Al provenir los

datos de diferentes fuentes deben establecerse mecanismos para validar los datos en

cuanto a sus consistencias y la cantidad de posibles variantes del mismo dato. Si esto es

un factor crítico para solo datos estructurados, lo es más para datos estructurados y no

estructurados de todo tipo que considera el Big Data.

7.5 Diseño adecuado del modelo de datos: Que permita producir información de

calidad de acuerdo con los requerimientos del negocio.

7.6 Diseño de una arquitectura de la Solución que permita ser escalable: Tanto a

nivel de volumen de datos como en la complejidad del Negocio, es decir, si ocurren

cambios en las reglas de negocio o si se incorporan nuevas variables al mismo.

8.- Descripción de un caso de implementación exitosa en el Perú

sdf

Partiendo de la premisa que el propósito primario del big data es analizar conjuntos de

datos relacionados al comportamiento humano y sus comunicaciones para revelar

patrones o tendencias, a continuación, revisaremos dos casos, uno en el sector público y

el otro en la banca del sector privado.

El primer caso es un Sistema de Análisis de Viajes en lima con la finalidad de mejorar la

red el Metro de Lima y Callao. La Autoridad Autónoma del Tren Eléctrico (AATE) con la

ayuda de la unidad de datos de Telefónica (LUCA) realizaron un estudio por medio de

LUCA Transit, una solución de Big Data y Analytics para analizar los datos de movilidad

generados por los teléfonos móviles de las personas y sus múltiples viajes que

diariamente realizan permitiendo conocer los puntos de inicio y fin, segmentación

demográfica y propósito del mismo con el objetivo futuro de planificar las líneas del metro

en base a las necesidades reales, reduciendo el número de transbordos que las personas

realizan. Este estudio se realizó el 2017, durante 4 meses las 24 horas del día en 50

distritos de Lima y Callao divididos en 330 zonas.

Dirección de Tecnologías de Información 14

Maestría en Dirección de Tecnologías de la Información

Extra oficialmente este proyecto tiene 5 fases las primeras fueron de levantamiento de

datos y de análisis, en la 4 etapa que inicia en septiembre se va a definir una metodología

para integrar la data al plan maestro 2050 y la quinta y última iniciará en octubre.

Imagen 8.1: Big Data y el estudio de movilidad, AATE.

El segundo caso es “CreceMas”, un proyecto del BCP. Este proyecto está dirigido a los

negocios de ventas como restaurantes, tiendas, etc. Crecemas consolida la información

de los pagos realizados por los clientes con tarjetas de crédito o débito del BCP y la

complementa con la información adicional que el banco tiene de los mismos (clientes

empresa y persona). Este proyecto es una rica fuente de información para los negocios

pues les brinda información consolidada de preferencias, segmentos, distritos de los

cuales provienen los clientes e incluso permite conocer el comportamiento de tu

competencia, lo que permite diseñar estrategias, campañas o apertura de nuevos locales

fundamentadas en información.

Dirección de Tecnologías de Información 15

Maestría en Dirección de Tecnologías de la Información

Imagen 8.2: Dashboard, crecemas.

9.- Proyección de avances tecnológicos en el futuro

Una nueva generación de tecnología y la disponibilidad de datos generados por redes

sociales y dispositivos conectados a internet junto con un cambio cultural hacia la toma de

decisiones basadas en datos continúan impulsando la demanda de tecnología para poder

aprovechar esos datos y transformarlos en información en tiempo real. A continuación,

mencionaremos algunas de las proyecciones para el futuro del Big Data y Analytics.

Hoy en día los datos son capturados en un punto y luego son transmitidos a data

centers o clouds donde luego son procesados y analizados. La proyección es ser

capaz de consumir esos datos en tiempo real, analizarlos donde se generaron

(Edge Computing) lo cual permitirá mejorar el performance y ahorrar costos en

cloud computing. Esta proyección viene de la mano con Multi Cloud/Hybrid

Providers debido a que los datos se generan en múltiples instancias y los

proveedores de cloud deben ser capaces de integrarse a través de protocolos

abiertos y evitar a los clientes limitarse o bloquearse a un proveedor.

Empoderamiento de las aplicaciones para la toma de decisiones, las aplicaciones

inteligentes (no personas) serán los principales consumidores mediante la

integración de Machine learning, artificial intelligence and data analytics, el

software estará habilitado para actuar sobre los datos por nosotros, ya sea de

máquina a máquina o de máquina a consumidor, en lugar de simplemente

Dirección de Tecnologías de Información 16

Maestría en Dirección de Tecnologías de la Información

presentar los datos para que las personas los examinen y utilicen para tomar

decisiones. El auge de las aplicaciones inteligentes resolverá el problema de “Data

staffing Crisis” (problemas para conseguir personas con skills específicos).

Por décadas los ingenieros de software han confiado en la optimización de

software para correr complejos programas, pero hay limitaciones en la

optimización. En algún punto se necesitará computadoras más poderosas para

cumplir nuestros requerimientos. Quantum Computing puede re-definir como

nosotros interactuamos en los distintos campos de estudio. Actualmente analizar

big data en un nivel granular es casi imposible, algunos patrones pueden no ser

tan obvios para la investigación y podemos perder datos valiosos en un mar de

ruido. Poderosos procesadores cuánticos podrían ser capaces de manejar

masivos datasets y la inteligencia artificial podría analizar big data en un nivel

granular.

10.- Conclusiones

Big Data crea valor cuando se utiliza para retos empresariales (casos de negocio),

para ello es necesario tener acceso a variedad de datos (estructurados y no

estructurados), además de contar con sólidas funcionalidades analíticas

incluyendo (software y habilidades).

Big Data permite obtener una imagen más completa de las preferencias y

demandas de los clientes, en consecuencia, las empresas de diferente rubro

encuentran nuevas formas de relacionarse con sus clientes actuales y futuros.

La disponibilidad de datos, una nueva generación de tecnología y un cambio

cultural hacia la toma de decisiones basada en datos continúan impulsando la

demanda de tecnología y servicios de Big Data y análisis.

La adopción de Big Data se enfoca especialmente en crear valor cuantificable para

el negocio.

En la actualidad, los desafíos que obstaculizan la adopción de Big Data difieren del

grado de adopción que tiene la empresa.

Dirección de Tecnologías de Información 17

Maestría en Dirección de Tecnologías de la Información

11.- Bibliografía

AT INTERNET (2018): Glosario Data Analytic. Recuperado de:

https://www.atinternet.com/es/glosario/data-analytics/

VE (2016): Qué es Big Data: Fases y Elementos. Recuperado de:

https://www.ve.com/es/blog/que-es-big-data-fases-elementos

LOGICALIS (2014): Big Data Analytics: En qué consiste y cómo beneficia a tu

empresa. Recuperado de: https://blog.es.logicalis.com/analytics/en-que-consiste-

big-data-analytics-y-como-beneficia-a-tu-empresa

Autoridad Autónoma del Sistema Eléctrico de Transporte Masivo de Lima y Callao

| Metro de Lima. (n.d.). Recuperado de: http://bigdata.aate.gob.pe:3009/

Big Data Trends. (n.d.). Recuperado de: https://www.datamation.com/big-data/big-

data-trends.html

Crecemás BCP. (n.d.). Recuperado de https://www.crecemasbcp.com/

How AI and Quantum Computers Could Bring Massive Change. (2018, September

29). Recuperado de: https://insidebigdata.com/2018/09/28/ai-quantum-computers-

bring-massive-change

IDC FutureScape: Worldwide IT Industry 2019 Predictions. (2018, October 30).

Recuperado de: https://www.brighttalk.com/webcast/15909/334915/idc-

futurescape-worldwide-it-industry-2019-predictions

Ramasamy, K. (2019, February 22). 2019 Data Predictions: Demise Of Big Data

And Rise Of Intelligent Apps. Recuperado de:

https://www.forbes.com/sites/forbestechcouncil/2019/02/22/2019-data-predictions-

demise-of-big-data-and-rise-of-intelligent-apps/#2eade990753c

Luis Joyanes Aguilar. (julio 2013). Big Data: Análisis de Grandes Volúmenes de

Datos en Organizaciones. Mexico D.F.: Alfaomega Grupo Editor S.A..

The Origins of Big Data (2017, February 21) Recuperado de:

https://www.kdnuggets.com/2017/02/opinions-interviews.html

Las siete ‘V’ del Big Data (2019, Abril 26) Recuperado de:

https://bbvaopen4u.com/es/actualidad/las-siete-v-del-big-data

María Korolov, Network World (2013, Agosto 12) Recuperado de:

https://www.networkworld.com/article/2288276/114134-15-most-powerful-Big-Data-

companies.html

Dirección de Tecnologías de Información 18

Maestría en Dirección de Tecnologías de la Información

Jeff Kelly (2014, Febrero 12) Recuperado de:

http://wikibon.org/wiki/v/Big_Data_Vendor_Revenue_and_Market_Forecast_2013-

2017

Framingham, Mass (2019, Abril 4) Recuperado de:

https://www.idc.com/getdoc.jsp?containerId=prUS44998419

Alex Bekker (2018, Marzo 21) Recuperado de: https://www.scnsoft.com/blog/big-

data-challenges-and-their-solutions#understanding

IBM Institute for Business Value & Escuela de negocios de la universidad de

Oxford (2012). Informe ejecutivo. Analytics: el uso del big data en el mundo real.

Recuperado de: https://www-

05.ibm.com/services/es/gbs/consulting/pdf/El_uso_de_Big_Data_en_el_mundo_rea

l.pdf

Dirección de Tecnologías de Información 19

Вам также может понравиться

- Curso de Redes WiffiДокумент189 страницCurso de Redes WiffiAnonymous ilKIddHJq100% (1)

- Gobierno de Datos - EstudioДокумент230 страницGobierno de Datos - EstudioHernan LabastieОценок пока нет

- Tesis UpcДокумент145 страницTesis UpcEstudiante2 UPCОценок пока нет

- Transformacion Digital de MIPYMESДокумент61 страницаTransformacion Digital de MIPYMESRene CalderonОценок пока нет

- Ejercicios ResueltosДокумент10 страницEjercicios ResueltosJesus San50% (2)

- Caso Nabisco Perú VFДокумент11 страницCaso Nabisco Perú VFMiguel Angel Renteria CoronelОценок пока нет

- Cuadro Comparativo ERP SДокумент3 страницыCuadro Comparativo ERP SMatias BarbozaОценок пока нет

- Caso Magazine Luiza Blaz AlemanДокумент6 страницCaso Magazine Luiza Blaz AlemanAdelita Aleman Iman de Blaz0% (1)

- Examen Final Paulocesar VillagomezДокумент7 страницExamen Final Paulocesar VillagomezKARIN EUGENIA VIDAL SOBRADOОценок пока нет

- Bloomberg IntroДокумент16 страницBloomberg IntroRodrigo Garay0% (1)

- Direccionamiento IPv4 básicoДокумент27 страницDireccionamiento IPv4 básicoHector MarchesiОценок пока нет

- Cuadrante Mágico de GartnerДокумент7 страницCuadrante Mágico de GartnerSandra ContentoОценок пока нет

- Nabisco PeruДокумент5 страницNabisco PerudialuccОценок пока нет

- Presentación TrabajoДокумент24 страницыPresentación TrabajoKiara VargasОценок пока нет

- Funcionamiento memoriaДокумент6 страницFuncionamiento memoriaFernandoUlisesSaldañaGonzalezОценок пока нет

- Proyecto de Business Intelligence para L PDFДокумент49 страницProyecto de Business Intelligence para L PDFRené Felipe ViancosОценок пока нет

- Plan EstrategicoДокумент12 страницPlan EstrategicoAlma Mia SalcedoОценок пока нет

- Informe Juego Negocios - Grupo 6 - JhonДокумент11 страницInforme Juego Negocios - Grupo 6 - JhonJhon Grandez100% (1)

- Examen Parcial GETAOP PDFДокумент12 страницExamen Parcial GETAOP PDFDaniel Ricardo SQОценок пока нет

- 2018 Matp16-3 10 TДокумент183 страницы2018 Matp16-3 10 TJuan Jose GutierrezОценок пока нет

- Comercio Electrónico y La Reactivación EconómicaДокумент86 страницComercio Electrónico y La Reactivación EconómicaRodrigo CastilloОценок пока нет

- Gestión Riesgos Socioambientales PetróleoДокумент112 страницGestión Riesgos Socioambientales PetróleoluciocondoriОценок пока нет

- Taf - FCSДокумент3 страницыTaf - FCSCésar Jesús Bautista HernándezОценок пока нет

- Nabisco Perú Caso de EstudioДокумент9 страницNabisco Perú Caso de EstudioCelestino Roberto Hernández MolinaОценок пока нет

- Sistema de Pronóstico de La Demanda de Productos PDFДокумент142 страницыSistema de Pronóstico de La Demanda de Productos PDFlucasОценок пока нет

- MBA81 TAF GRUPO 1 Investigacion de MercaДокумент12 страницMBA81 TAF GRUPO 1 Investigacion de MercaLUIS ALFREDO MEJIA LAURAОценок пока нет

- Proyecto Business Intelligence CargueДокумент15 страницProyecto Business Intelligence CargueAnonymous q5f5MncqPfОценок пока нет

- BPM Sesión 3-4Документ26 страницBPM Sesión 3-4Eduin Chacaltana0% (1)

- Brief App Movil Educativo (Aja Media) Evidencia 07Документ16 страницBrief App Movil Educativo (Aja Media) Evidencia 07Sergio Alejandro MontealegreОценок пока нет

- BASES - DESAFÍO - KUNAN - 2019 - GRAN PREMIO KUNAN y Premios CategoríasДокумент11 страницBASES - DESAFÍO - KUNAN - 2019 - GRAN PREMIO KUNAN y Premios CategoríascristianОценок пока нет

- T1 Negocios Digital Grupo 5 PDFДокумент10 страницT1 Negocios Digital Grupo 5 PDFOscar BAОценок пока нет

- S13.s1 - Material GPP Lean Manufacturing - Semana 13 - 2021Документ25 страницS13.s1 - Material GPP Lean Manufacturing - Semana 13 - 2021Katerin PradoОценок пока нет

- Vigilancia Tec Vs BenchmarkingДокумент12 страницVigilancia Tec Vs BenchmarkingJocelyne MontielОценок пока нет

- Caso - Ganar La ApuestaДокумент13 страницCaso - Ganar La Apuestaalvag.andre1Оценок пока нет

- Mesa Redonda Nro 1Документ4 страницыMesa Redonda Nro 1Cesar Paredes NoaОценок пока нет

- Diagnóstico de problemas informáticos en el Banco de Crédito del PerúДокумент4 страницыDiagnóstico de problemas informáticos en el Banco de Crédito del Perúricardo24_42Оценок пока нет

- Taf - Grupo-01 - Gestion de DatosДокумент6 страницTaf - Grupo-01 - Gestion de DatosDiego Warthon HurtadoОценок пока нет

- TP Grupo7 LogísticaДокумент27 страницTP Grupo7 LogísticaCristina PinedoОценок пока нет

- Arquitectura Big DataДокумент11 страницArquitectura Big DataTitoОценок пока нет

- Introducción a la minería de datos y CRISP-DMДокумент22 страницыIntroducción a la minería de datos y CRISP-DMtareasОценок пока нет

- El Lado Oscuro Del Bi r0705a-PDF-spa - DPДокумент5 страницEl Lado Oscuro Del Bi r0705a-PDF-spa - DPj110205kОценок пока нет

- Cemento PacasmayoДокумент18 страницCemento PacasmayoYesterday Quispe100% (1)

- Trabajo Final Gerencia de AlmacenesДокумент8 страницTrabajo Final Gerencia de AlmacenesGerardo Paja100% (1)

- 2017 Matc 16-2 01 TДокумент255 страниц2017 Matc 16-2 01 TAnonymous 1Ki5dlENpОценок пока нет

- Automatización del proceso de empaque en una panadería artesanal utilizando FluidSimДокумент25 страницAutomatización del proceso de empaque en una panadería artesanal utilizando FluidSimricardo TarazonaОценок пока нет

- Estudio Caso FoxMeyerДокумент5 страницEstudio Caso FoxMeyerzs.kastielОценок пока нет

- Machine LearningДокумент21 страницаMachine LearninghernancОценок пока нет

- EFC ProveedoresДокумент6 страницEFC Proveedoressantiago salesОценок пока нет

- Mineria de DatosДокумент7 страницMineria de DatosJoshep EstrellaОценок пока нет

- Modelo de Negocios GOOGLE 2019Документ34 страницыModelo de Negocios GOOGLE 2019MynorОценок пока нет

- Caso Domino SДокумент3 страницыCaso Domino SGabriela SaucedoОценок пока нет

- El MolinitoДокумент9 страницEl MolinitoLIXY22Оценок пока нет

- Machine LearningДокумент2 страницыMachine LearningLuis Enrique Guisado GuerraОценок пока нет

- Extracción de informaciónДокумент21 страницаExtracción de informaciónGus Barrera RodriguezОценок пока нет

- ColdexДокумент6 страницColdexcmilton3nriqu3Оценок пока нет

- Caso 1 Pi GOPДокумент8 страницCaso 1 Pi GOPMacarenaC.SandovalMarabolíОценок пока нет

- Facultad de Administracion y Negocios CorregidoДокумент24 страницыFacultad de Administracion y Negocios Corregidoteseo_4Оценок пока нет

- Plan estratégico de tecnología municipal 2020-2023Документ36 страницPlan estratégico de tecnología municipal 2020-2023Juan Fernando Ramirez AgudeloОценок пока нет

- PetApp Final Eje4Документ24 страницыPetApp Final Eje4Fernando Alberto Velasquez AguileraОценок пока нет

- Trabajo Final Integrador Programa Ejecutivo Retail Ecommerce Version Online & Semipresencial 2021 - Trabajo Final IntegradorДокумент12 страницTrabajo Final Integrador Programa Ejecutivo Retail Ecommerce Version Online & Semipresencial 2021 - Trabajo Final IntegradorJordi EspinosaОценок пока нет

- Planeamiento AgregadoДокумент11 страницPlaneamiento AgregadoWinner-Winnen Ww-sj SalvatierraОценок пока нет

- Big Data, Una Realidad Que Está Cambiando Nuestra Vida - MasScienceДокумент6 страницBig Data, Una Realidad Que Está Cambiando Nuestra Vida - MasScienceGambito Chuarliecads TrrereОценок пока нет

- Ensayo Big DataДокумент20 страницEnsayo Big DataTyrone Arceo GarciaОценок пока нет

- Ficha Bibliografica Actividad 3Документ7 страницFicha Bibliografica Actividad 3Perla VirtuosaОценок пока нет

- RedTelefoniaCentroMedicoДокумент9 страницRedTelefoniaCentroMedicoJOSUE CLARO HERNANDEZОценок пока нет

- Control EpiisДокумент38 страницControl Epiispap sicОценок пока нет

- Tipos de ComputadoresДокумент2 страницыTipos de ComputadoresAndry yamirys Guzman de jesusОценок пока нет

- Domótica e InmóticaДокумент49 страницDomótica e InmóticaMoises Mendez AlbarracinОценок пока нет

- TFG - El Proyecto Profesional y La Construcción de Itinerarios de Inserción Laboral Del Pedagogo.Документ27 страницTFG - El Proyecto Profesional y La Construcción de Itinerarios de Inserción Laboral Del Pedagogo.Antonio Fernández JorgeОценок пока нет

- Elementos de Una RedДокумент4 страницыElementos de Una RedOmar MartinezОценок пока нет

- Preguntas RedesДокумент60 страницPreguntas RedesjorgeОценок пока нет

- Expresiones Comunicativas y TicДокумент22 страницыExpresiones Comunicativas y TicCesar Julian Orozco CepedaОценок пока нет

- Microdiseño Introducción A Los Sistemas ComputacionalesДокумент6 страницMicrodiseño Introducción A Los Sistemas Computacionalesdguete100% (1)

- Copeg Invenario TOTAL-guia DavidДокумент8 страницCopeg Invenario TOTAL-guia DavidDiego ZarazaОценок пока нет

- Para Obtener Mensajes Contenidos en El Dispositivo Sería Algo Así: AT+CMGLДокумент8 страницPara Obtener Mensajes Contenidos en El Dispositivo Sería Algo Así: AT+CMGLDevice DesolatorОценок пока нет

- ScribdДокумент44 страницыScribdPAPOFULEОценок пока нет

- Neurocienciaaplicadalaeducacionyelaprendizaje 120912113122 Phpapp02Документ6 страницNeurocienciaaplicadalaeducacionyelaprendizaje 120912113122 Phpapp02Yolo BurОценок пока нет

- Manual de Usuario Del Emona SigexДокумент2 страницыManual de Usuario Del Emona SigexfuerierОценок пока нет

- Optimización de la red NGN en CubaДокумент116 страницOptimización de la red NGN en CubaDiego I. HernándezОценок пока нет

- El Desarrollo Tecnológico en La Historia - Leornardo OrdoñezДокумент23 страницыEl Desarrollo Tecnológico en La Historia - Leornardo OrdoñezEduardo Vega CatalánОценок пока нет

- Obra CivilДокумент33 страницыObra CivilJorge CepedaОценок пока нет

- Guia Redes 3Документ6 страницGuia Redes 3Camilo Beltran GranadosОценок пока нет

- CiberdelincuenciaДокумент40 страницCiberdelincuenciaLuis RaimundoОценок пока нет

- Dialnet LaRadiodifusionEnSantaMartaColombia19301940 7269291Документ24 страницыDialnet LaRadiodifusionEnSantaMartaColombia19301940 7269291Yanidis Diaz AОценок пока нет

- Modulo I TicДокумент47 страницModulo I TicfelipenirayОценок пока нет

- Ciencias Aplicadas A La Actividad - Profesional - T - ESO4Документ9 страницCiencias Aplicadas A La Actividad - Profesional - T - ESO4Anonymous 8lX1nYmОценок пока нет

- Arquitectura de La Computación GridДокумент11 страницArquitectura de La Computación GridDan-TcliffОценок пока нет

- Práctica 4 - Skills Integration ChallengeДокумент9 страницPráctica 4 - Skills Integration ChallengeAMERICA BERENICE AGUILA HERNANDEZОценок пока нет

- Suma y Sigue Esp-IngДокумент424 страницыSuma y Sigue Esp-IngAna Tempus FugitОценок пока нет

- Guia para Eleccion de Un Sistema Con Reconocimiento FacialДокумент27 страницGuia para Eleccion de Un Sistema Con Reconocimiento FacialLuis Manuel Flores DueñasОценок пока нет